本期导读:

本周的AI新闻,像极了一场双轨并行的戏剧:一边是巨头们在算力和芯片上的豪赌——Meta锁定算力、Cerebras冲击IPO、MTIA芯片悄然接管40%的内部工作负载;另一边,现实却在悄悄泼冷水——Tokenmaxxing数据显示AI生成的代码有一大半需要重写,72%的企业用上了AI智能体却依然找不到ROI。这个行业最有趣的地方,就在于它同时容纳了最狂热的乐观主义和最冷峻的现实主义。

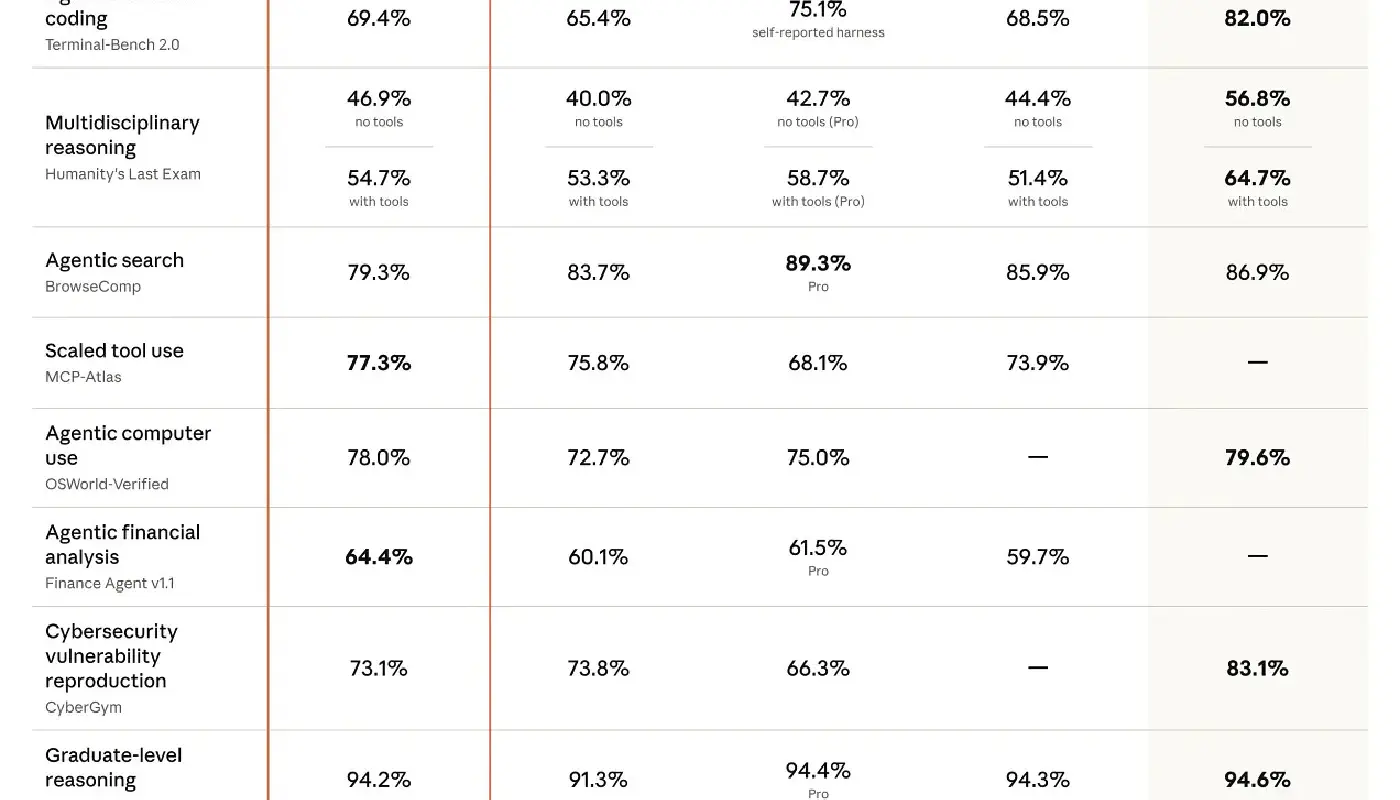

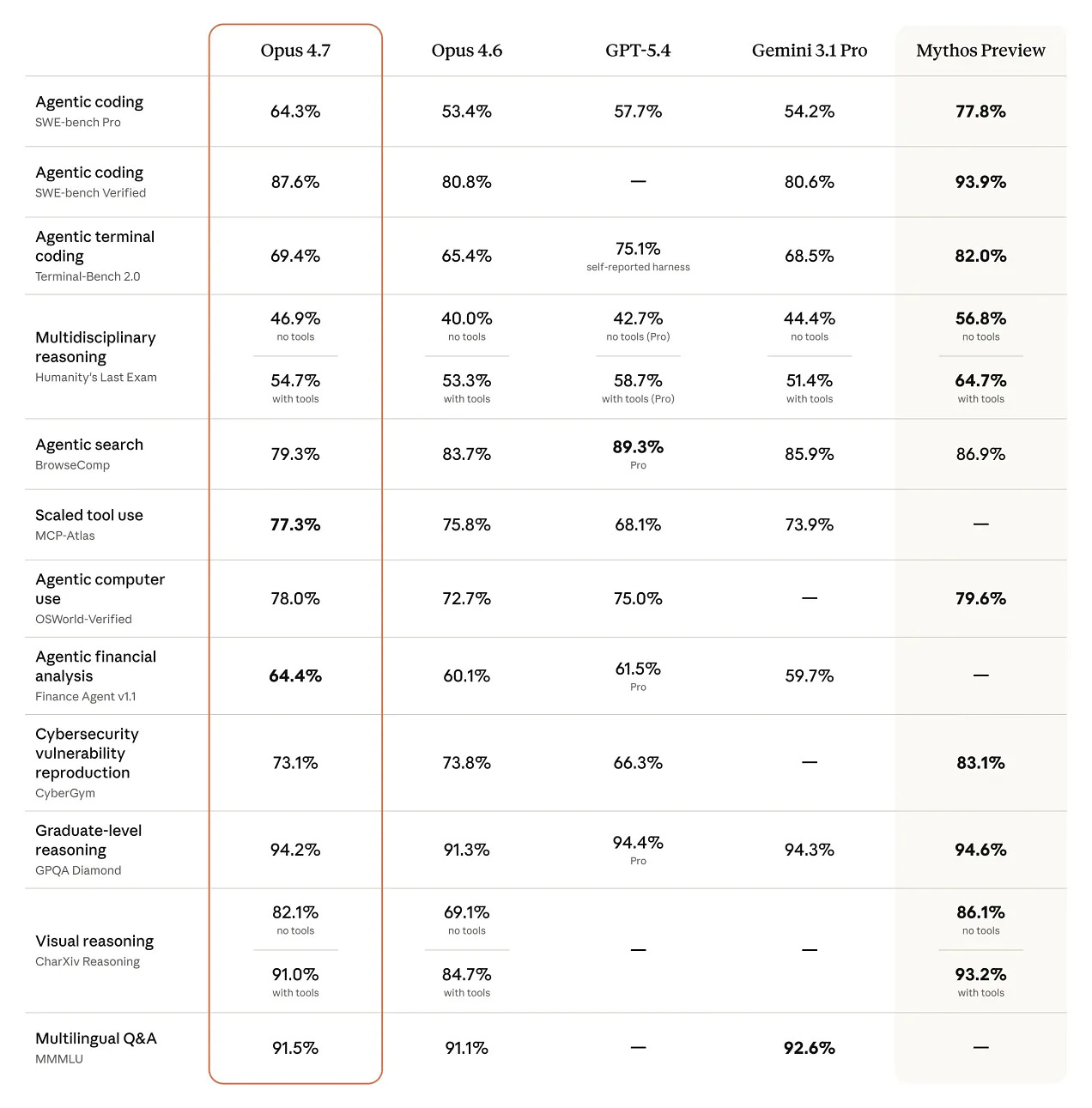

1. Claude Opus 4.7 强化企业级编程、视觉与长任务执行能力

Anthropic于2026年4月16日发布Claude Opus 4.7,将其定位为更适合专业与企业场景的旗舰模型。相较Opus 4.6,新版本在软件工程、长文档处理、多步骤推理与高分辨率视觉理解上明显增强,并可连续执行长达数小时的任务。官方强调其指令遵循更稳定、幻觉更少,同时新增网络安全护栏。

Opus 4.7的发布时机耐人寻味:在GPT-5系列密集轰炸的档口,Anthropic选择用一个"更稳"而非"更强"的版本应战。这其实是一种成熟的产品策略——对于真正的企业客户,指令遵循稳定性和幻觉率,比跑分高出5个百分点重要得多。

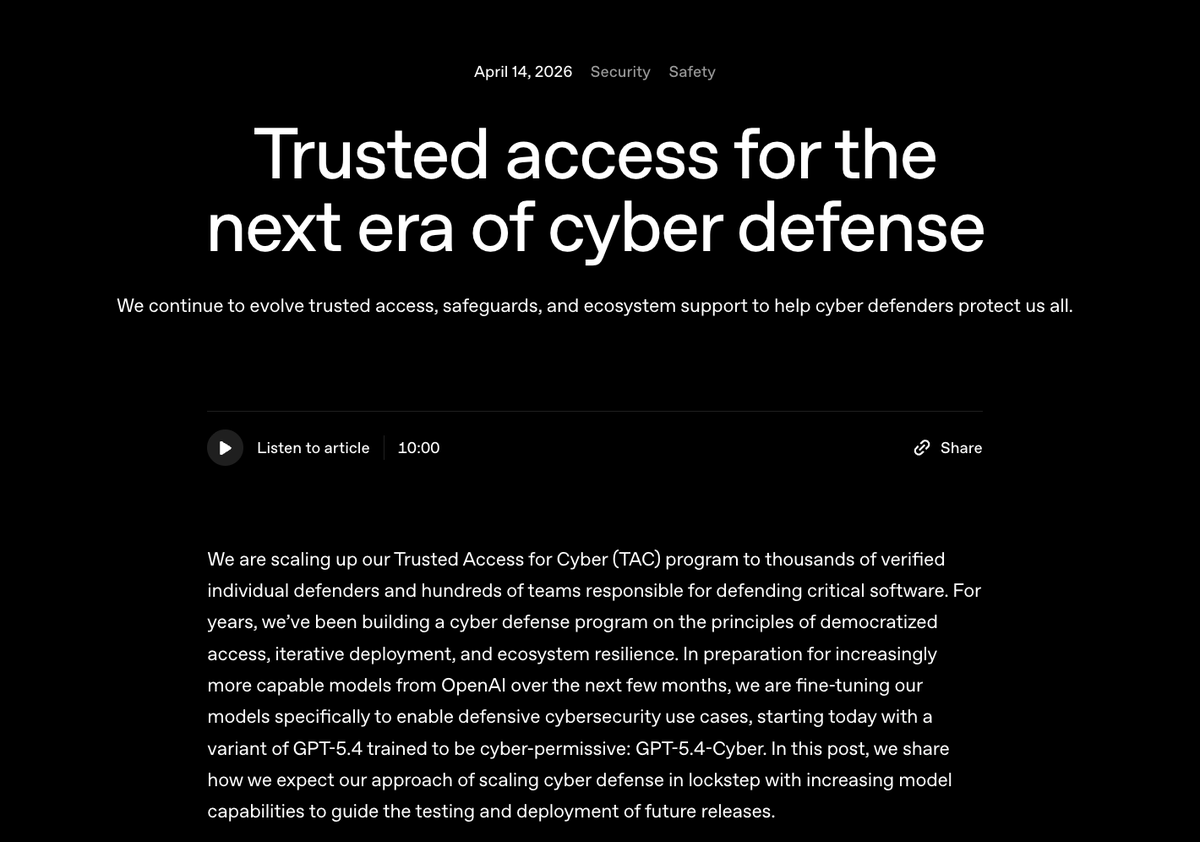

2. OpenAI 发布 GPT-5.4-Cyber 及网络安全可信访问计划

OpenAI于2026年4月15日推出GPT-5.4-Cyber,这是其首个面向网络安全的垂直模型,并同步启动"可信访问计划",向经过审核的安全研究机构和企业提供早期访问权限。该模型在漏洞分析、威胁检测和安全代码审查上有针对性优化。

把网络安全模型包装成"受信任的访问",这是典型的OpenAI式叙事。但这笔账很清晰:与其在红海里卷通用能力,不如在合规要求极高、预算充足的B端细分赛道里筑起高墙。这门生意,拼的不是参数,而是信任背书。

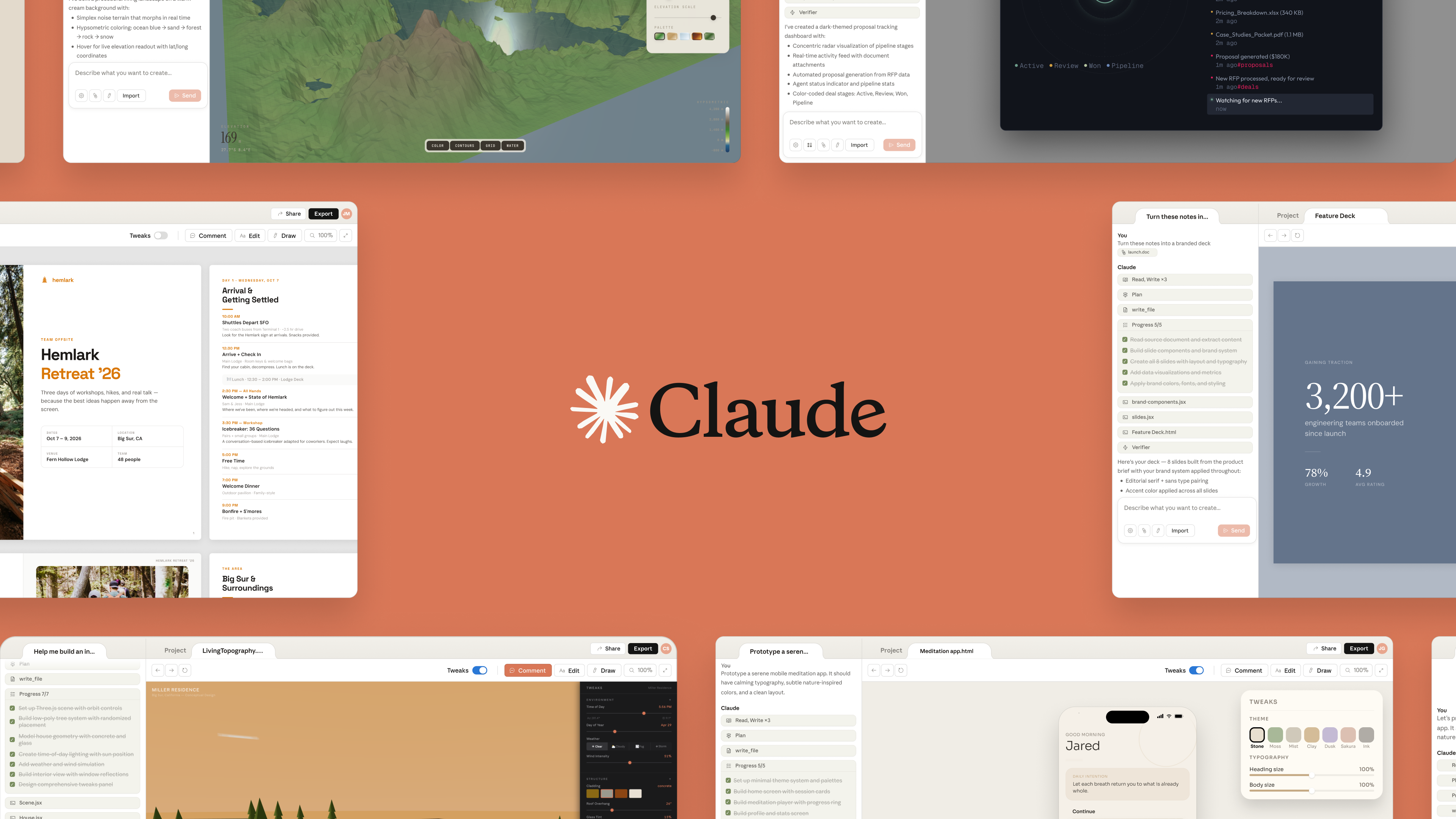

3. Anthropic 推出 Claude Design,将 Claude 从构思延伸至可交付的视觉创作

Anthropic于2026年4月17日推出Claude Design,这是一项Anthropic Labs实验性产品,可让用户通过文本提示生成原型界面、演示文稿、单页方案和营销版式等视觉交付物。

Claude Design把设计从"手艺活"变成了"工业品"。当机器能在一秒钟内吐出十个高保真原型,人类设计师的护城河还剩下什么?也许只有对业务逻辑的深刻理解——这恰好是AI最难学会的东西。

4. OpenAI 宣布"几乎所有事物的 Codex"愿景,支持跨应用智能体与深度集成

OpenAI在4月16日的产品更新中推出"几乎能做任何事的Codex",使该AI能够跨应用操作。新版本具备后台执行功能,用户可在AI运行任务的同时开展其他工作;内置浏览器让代理在应用内搜索资料;支持90多个插件并整合办公和开发工具。

OpenAI把Codex扩展到"几乎所有事物",这野心够大。但代码生成的本质是确定性,而"所有事物"往往充满模糊性。这种跨界能否成功,不仅取决于模型的泛化能力,更取决于它能否在复杂业务逻辑中保持不犯错。

5. OpenAI 高层动荡:Kevin Weil 与 Bill Peebles 离职另谋新方向

TechCrunch 4月17日报道,OpenAI两名高管宣布离职:负责科研的Kevin Weil在推出GPT-Rosalind后将离开;Sora视频模型的创造者Bill Peebles也宣布离职。公司正在削减"Sora"等非核心项目,重新聚焦企业AI和计划中的"超级应用"。

高层震荡在OpenAI似乎成了家常便饭。这不仅仅是人事更迭,更是技术路线和商业变现之间持续博弈的缩影。当一家公司承载了太多改变世界的期望,内部的裂痕往往比外部的竞争更致命。

6. Meta 工程博客:统一 AI 智能体如何在超大规模下优化容量效率

Meta在2026年4月16日披露,其统一AI智能体平台已用于容量效率计划,帮助大规模基础设施自动发现并修复性能问题。该动态的重要性在于,它展示了智能体AI并不只适用于面向用户的助手场景,也可直接用于内部运维与资源优化。

Meta把算力调度做成了一门内部科学,这篇工程博客的价值远超它表面看起来的那样。当一家公司的AI推理规模大到需要专门的智能体来优化容量分配,这本身就说明AI已经成为其核心基础设施,而不只是一个功能。

7. Meta 与博通深化自研 AI 芯片合作,围绕下一代 MTIA 硅片展开

Meta与Broadcom于2026年4月15日扩大合作,将共同开发多代MTIA定制AI芯片。Meta强调,此举旨在增强其对训练与推理成本结构的控制;双方将利用Broadcom的2纳米XPU平台、先进封装能力以及首批超过1吉瓦的算力供给,并计划进一步扩展到数吉瓦级别。

MTIA芯片的进展,是Meta试图摆脱对Nvidia依赖的无奈之举。自研芯片的坑深不见底,但对于这些消耗算力如流水的巨头来说,哪怕只能省下10%的成本,这笔账也是划算的。算力竞争正在从"买买买"转向"造造造"。

8. 起亚投资者日披露机器人战略:部署波士顿动力机器人并承诺投入 330 亿美元

在4月13日举行的Kia投资者日上,首席执行官宋虎成宣布公司未来将以机器人为核心。Kia计划2028年起在工厂部署Boston Dynamics的Atlas仿人机器人,并在平台化出行(PBV)概念下引入Spot和Stretch机器人用于物流和"最后一公里"配送。

起亚在投资者日秀机器人,是传统制造业向资本市场发出的一个信号:我们不只是造车的,我们是造"会动的东西"的。但从展示到量产,中间隔着无数个工程难题。投资者买的是故事,工程师面对的是现实。

9. 人形机器人在北京半程马拉松上超越人类,展示中国机器人技术快速进步

路透社4月19日报道,北京亦庄半程马拉松再次安排了仿人机器人竞赛。参赛机器人从上一届的20支增加到100多支,许多机器人通过自主导航和机械双腿完成2公里环形赛道。由手机制造商荣耀开发的冠军机器人以50分26秒完赛,比人类冠军快10多分钟。

北京半程马拉松上的机器人,是具身智能走向大众视野的一次成功营销。技术需要场景去验证,更需要曝光去吸引资本。当机器人能和人类一起奔跑,那些关于"AI替代人类"的焦虑,似乎又具象了几分。

10. xAI 发布 Grok 语音转文字与文字转语音 API

xAI于2026年4月17日推出独立的Grok语音识别与语音合成API,支持批量与实时转写、词级时间戳、说话人分离、多声道处理、多语言识别,以及更自然的语音输出。其意义在于,xAI没有把语音仅作为助手产品的附属能力,而是将其平台化、API化,直接面向开发者开放。

Grok的降价策略,是马斯克在AI战场上打出的一记七伤拳。这不仅仅是为了抢夺开发者,更是为了把语音交互的成本打穿,为后续的具身智能铺路。当底层API变成白菜价,应用层的创新才可能真正爆发。

11. Stellantis 与微软深化五年 AI 与数字化转型合作伙伴关系

Stellantis与微软于2026年4月16日宣布为期五年的合作,将共同推进100多个AI项目,覆盖预测性维护、产品开发、数字功能、网络安全以及更广泛的企业转型。

Stellantis与微软的联手,是传统车企在智能化焦虑下的标准动作。这笔交易的看点不在于AI能立刻造出什么颠覆性的车,而在于它如何用数字化手段优化那冗长且低效的供应链。在汽车行业,降本增效的ROI,往往比那些炫酷的自动驾驶PPT来得更实在。

12. Cerebras Systems 提交美国 IPO 申请,此前已签署数十亿美元 AI 芯片合同

路透社4月17日报道,AI芯片制造商Cerebras Systems向美国证券监管机构提交了首次公开募股(IPO)申请。Cerebras以其晶圆级引擎芯片而著称,通过绕过高带宽内存瓶颈提供AI系统。

Cerebras的IPO,是算力市场对Nvidia霸权的一次集体试探。在CUDA生态已经形成铜墙铁壁的今天,仅靠单点性能的突破,真的能撕开一道口子吗?对于投资者而言,这不仅是买芯片,更是买一个"去Nvidia化"的梦想。

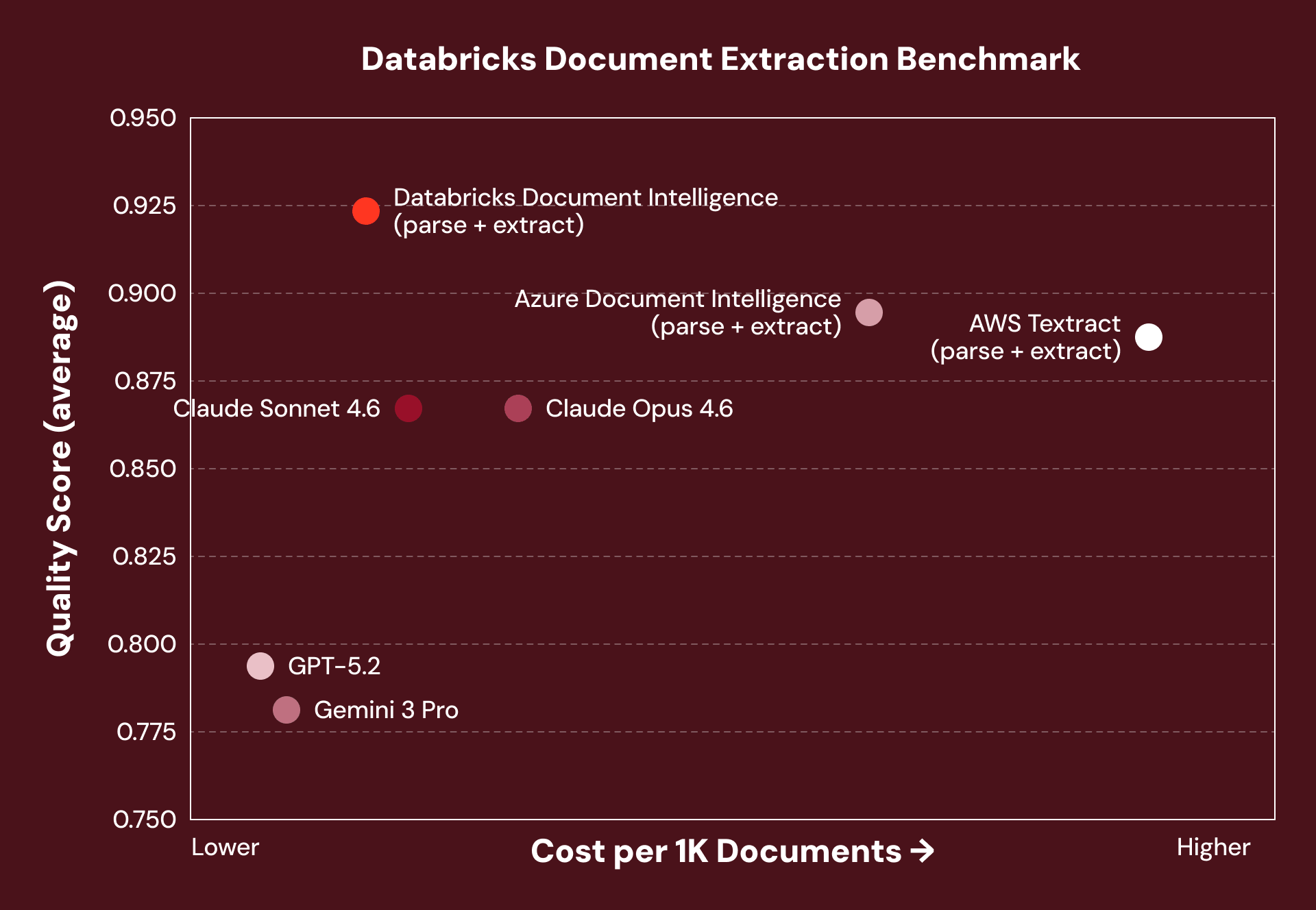

13. Databricks:为何前沿智能体无法读懂企业文档——以及我们的解决方案

Databricks于2026年4月16日提出一个很关键的判断:企业智能体当前最大的瓶颈不是"不会推理",而是"读不懂企业文档"。围绕这一问题,Databricks推出Document Intelligence,试图把复杂PDF、表格、图像和半结构化文档的理解能力平台化。

Databricks在文档智能上的发力,精准切中了企业级AI的痛点:大模型很聪明,但它们读不懂那些排版混乱的PDF和发票。在B端市场,解决那些脏活累活的工程能力,往往比模型本身的参数规模更有商业价值。

14. 亚马逊 Bedrock 推出细粒度成本归因功能

AWS于2026年4月18日宣布为Amazon Bedrock提供更细粒度的成本归因能力。这个更新看似偏管理,但对企业AI落地极为关键,因为很多项目扩不起来,不是模型不够强,而是无法准确知道成本究竟由哪个团队、哪个应用、哪个环境产生。

Amazon Bedrock的细粒度成本归因,是AWS在企业AI市场下的一步好棋。当AI的使用成本变得可追溯、可分摊,CFO们才会真正放心签那张采购单。这不是技术创新,而是商业化落地的关键一环。

15. 基于 Amazon Nova Micro 与 Bedrock 按需推理的低成本自定义 Text-to-SQL 方案

AWS于2026年4月16日展示如何利用更小的Amazon Nova Micro与Bedrock按需推理来实现低成本的定制化Text-to-SQL。虽然形式上像技术教程,但其商业意义很强,因为Text-to-SQL始终是最具落地价值的数据分析AI模式之一,真正阻碍上线的往往不是需求,而是成本和稳定性。

用Nova Micro做Text-to-SQL,这个案例的价值在于它展示了一个朴素的道理:对于大多数企业任务,用最便宜的够用模型,往往比用最贵的最强模型,ROI更高。AI选型,从来都是工程权衡,而不是参数比赛。

16. Netflix 推出垂直视频信息流,扩展 AI 驱动的个性化推荐

TechCrunch于4月17日报道,Netflix计划今年在应用中加入类似TikTok的竖屏视频流。联席CEO Gregory Peters与Ted Sarandos指出,公司利用具有新架构的生成式AI提升内容推荐和个性化,并通过AI生成镜头和背景辅助创作者。

Netflix把信息流做成TikTok的样子,是对用户注意力的重新争夺。当长视频的增长见顶,用AI推荐算法去榨取用户的碎片时间,成了最现实的选择。在算法面前,所有内容平台的最终归宿,可能都是短视频。

17. Sam Altman 的 World ID 接入 Tinder 并推出新身份验证服务

TechCrunch 4月17日报道,Sam Altman的创业公司World(前身Worldcoin)正在推广其人类验证技术。该公司使用"Orb"设备扫描虹膜,生成加密的World ID,让用户在数字服务中证明自己是真实的人。

World ID接入Tinder和Zoom,是Sam Altman为"数字身份"找到的最接地气的落地场景。在这个"眼见不一定为实"的AI时代,证明"我是个真人"的需求正变得前所未有的迫切。防伪造,可能比生成内容本身,是一门更赚钱的生意。

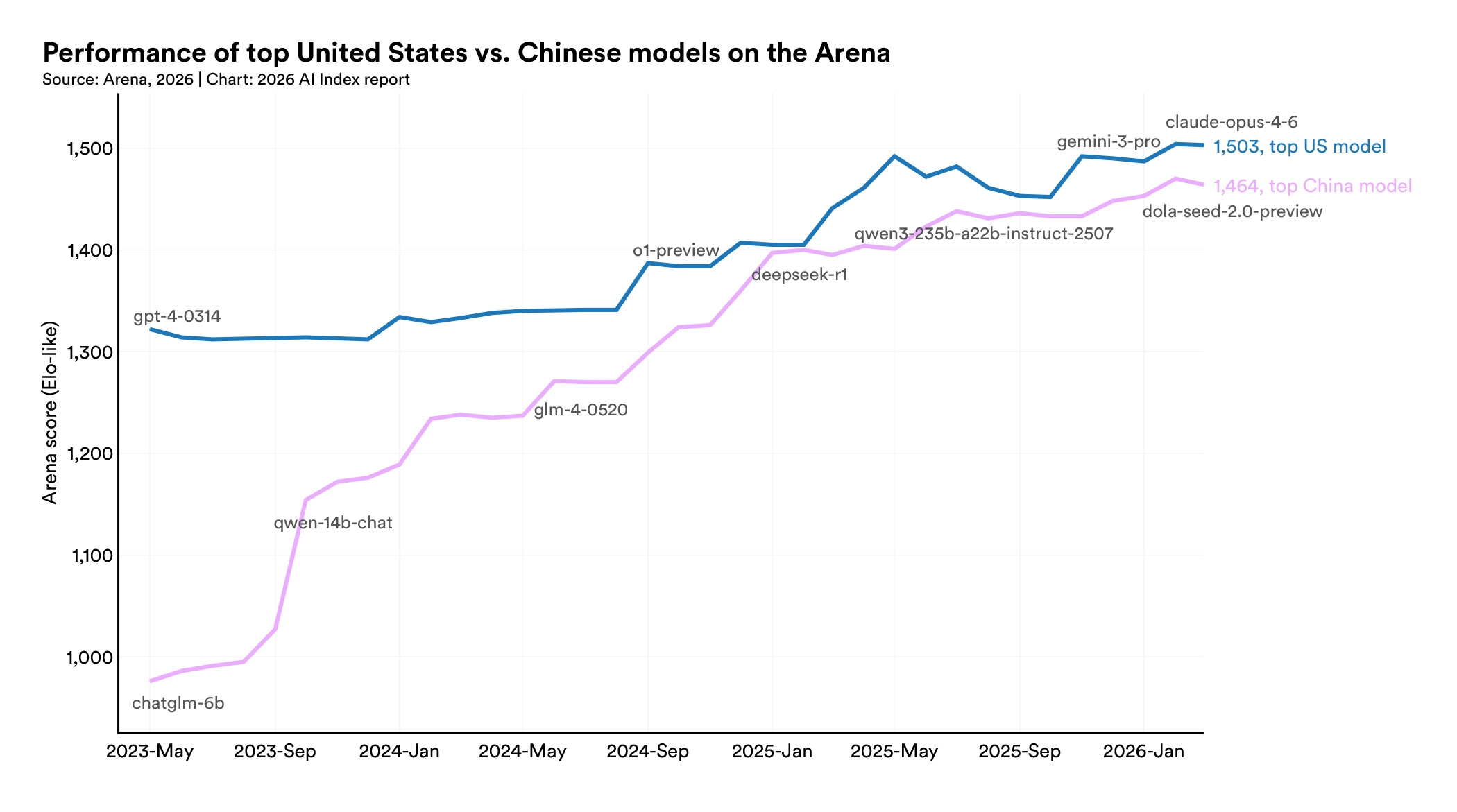

18. 斯坦福 2026 AI 指数:中美模型差距缩小,治理与劳动力问题凸显

斯坦福HAI于2026年4月13日发布《2026 AI Index》,系统梳理了AI能力、投资、就业、环境影响和治理等多个维度的发展趋势,是本周最重要的"宏观校准型"动态之一。

斯坦福AI指数揭示了一个冷酷的现实:中美AI模型的能力差距正在迅速缩小。这是开源生态和工程化能力的胜利。在这个赢家通吃的游戏里,没有谁能永远躺在功劳簿上睡大觉。

19. 路透社评论:中国以低成本 AI Token 策略对抗昂贵的美国模型

路透社的Breakingviews评论于4月15日聚焦中国对廉价AI词元的热潮。文章指出,中国监管机构提出"词元"正式定义,阿里巴巴和MiniMax等公司出售的词元价格仅为美国同类产品的六分之一。中国市场的词元消费量激增,供应商纷纷合作以抢占商机。

中国AI模型的"价格战",是典型的互联网打法在AI时代的重演。当技术差距不足以形成绝对壁垒时,用低价换规模、用规模换数据,成了最现实的策略。但在没有找到清晰的盈利模式前,烧钱能烧多久?

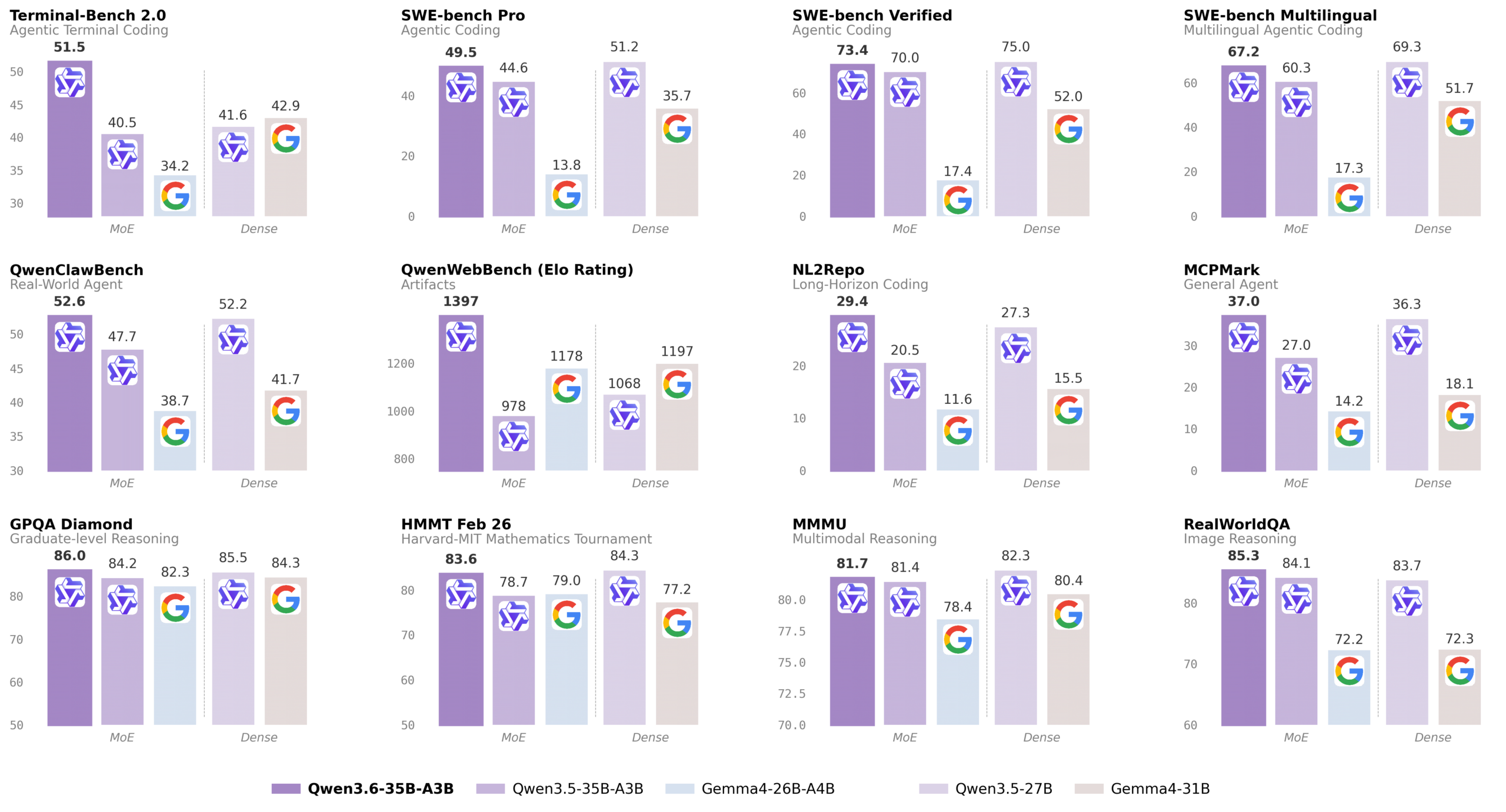

20. Qwen3.6 Flash 与 qwen3.6-35b-a3b 上线阿里云模型服务

阿里云于2026年4月16日在官方模型上新文档中加入Qwen3.6 Flash和开源权重qwen3.6-35b-a3b,重点突出其在智能体编程、数学推理、代码推理和空间智能上的增强,尤其强化了物体定位与检测等视觉能力。

Qwen 3.6在各项基准上的亮眼表现,再次证明了开源力量的恐怖。当开源模型的能力越来越逼近甚至超越闭源巨头时,那些靠API调用赚钱的商业模式,正面临着前所未有的挑战。开源是一种更高维度的商业竞争。

21. 腾讯发布并开源 HY-World 2.0 三维世界模型

腾讯于2026年4月16日发布并开源HY-World 2.0,这是一款多模态世界模型,可基于文本、图片和视频生成、重建和模拟三维世界,并支持Mesh、3DGS、点云等多种3D资产导出格式。其关键价值在于,腾讯将其明确指向游戏地图和关卡原型等现有生产流程,而不是停留在概念演示层面。

腾讯开源HY-World 2.0,是把大模型的能力真正落到了游戏工业的实处。与其在通用大模型上死磕,不如在自己最擅长的游戏场景里挖深护城河。用前沿技术去解决最核心的业务痛点,这才是巨头该有的务实。

22. 消息人士:Cursor 拟融资超 20 亿美元,估值达 500 亿,企业业务猛增

TechCrunch 于 4 月 17 日援引多位知情人士报道称,AI 编程初创公司 Cursor 正在洽谈一轮至少 20 亿美元的新融资,融资前估值约为 500 亿美元。报道指出,Thrive 与 Andreessen Horowitz 预计将继续领投,Battery Ventures 与 Nvidia 也可能参与。

Cursor的500亿估值,是资本市场对"AI改变生产力"最直接的投票。但它的高毛利建立在自研模型和成本优化的基础上——大型企业账户毛利为正,个人开发者账户仍在亏损。这个结构,和所有SaaS公司的成长路径如出一辙。

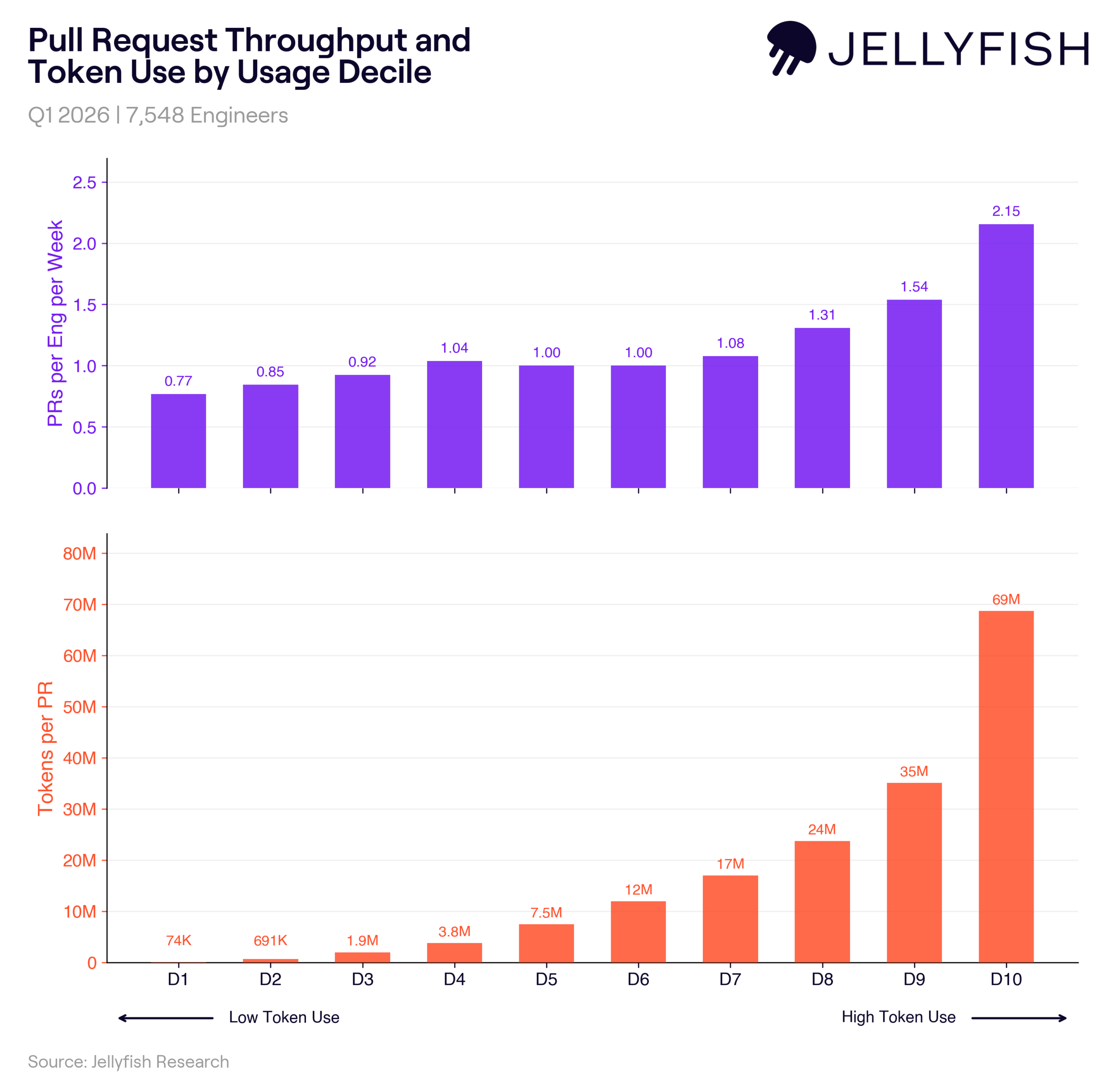

23. “Tokenmaxxing"正让开发者的实际效率低于预期

TechCrunch 于 4 月 17 日报道称,越来越多来自开发者分析平台的数据正在挑战一个流行假设,即"AI 用得越多,工程效率就越高”。文章把这种现象概括为"tokenmaxxing”,即企业内部把可消耗的 token 预算当作 AI 使用强度和生产力的象征。Jellyfish数据显示,最大token预算仅产生约2倍吞吐,却消耗了约10倍token成本。

“Tokenmaxxing"现象是对AI狂热的一记响亮耳光。当团队把消耗Token当成KPI,却发现产出的代码有一半要重写时,这就是典型的"伪工作”。在企业里部署AI,如果不能带来真实的业务增量,那它就只是一台昂贵的碎钞机。

本周 Takeaway

本周的主线很清晰:算力是门好生意,但应用层还在泥沼里挣扎。

当巨头们为芯片和电网争得头破血流时,企业客户却发现,用AI生成的代码有一大半需要重写。最危险的事,是把"消耗了多少Token"等同于"创造了多少价值"。对于从业者而言,别被估值500亿的独角兽晃花了眼,多去看看那些能真正降低企业摩擦成本、甚至像Netflix那样悄无声息改变用户习惯的落地场景。毕竟,淘金热里赚到钱的,往往是卖铲子和卖牛仔裤的人。