本周主线:当算力成为公用事业,智能体走向流水线

这周的AI圈,少了一些“颠覆人类”的宏大叙事,多了一些基建狂魔的泥土味和精算师的算盘声。一边是OpenAI把AI直接拔高到国家基础设施的战略高度,另一边是Anthropic为了不被英伟达和谷歌卡脖子,甚至动了自己下场造芯片的念头。而在应用端,从Databricks给智能体外挂“记忆库”,到AWS像管理API一样管理智能体目录:AI正在从实验室里的“魔法”,变成企业流水线上的“组件”。大家终于不再只问“这模型有多聪明”,而是开始算计“这东西耗多少电”、“出错了谁担责”以及“ROI到底能不能回正”。

1. OpenAI发布"智能时代"产业政策白皮书

OpenAI发布文件,将AI定位为决定国家竞争力的核心基础设施。其论点指出,AI商业化的真正瓶颈已从模型算法本身,彻底转移到算力、芯片供应链以及电力网络等硬性物理约束上。

AI从算法神坛被拉回了物理现实。把AI比作“基础设施”给所有企业敲响的警钟。你以为你在买软件服务,实际上你是在买未来的电网带宽。当算力成本与能源周期深度绑定,只按季度规划IT预算的公司,注定会在下个周期里掉队。

2. OpenAI:企业AI进入下一阶段,智能体成为新运营层

OpenAI宣布企业端营收占比已超40%,指出企业AI正从零散的工具试验,转向以智能体为核心的运营模式。其战略目标是打造一个统一的“智能层”,深度整合聊天、编程与企业级智能体群落。

一个危险又诱人的信号。OpenAI不再满足于做一个API供应商,而是想成为企业的“智能操作系统”。它动的是所有传统SaaS巨头的奶酪。对企业而言,把核心业务流交给一个黑盒智能体群,这已经超越了采购决策,而是一场关于数据主权和业务控制权的豪赌。

3. Anthropic探索自研AI芯片,以应对Claude需求激增

由于Claude模型需求激增且高端处理器成本居高不下,Anthropic正积极评估自研AI芯片的可能性,试图通过垂直整合硬件供应链,减少对英伟达的绝对依赖并降低长期推理成本。

Anthropic都被逼着去琢磨硅片了。这说明在当前的AI牌桌上,没有硬件层面的底牌,软件跑得再快也只是给卖铲子的人打工。但自研芯片是个动辄十亿美元起步的无底洞,这家明星独角兽的资本杠杆,还能撬动多重的物理世界?

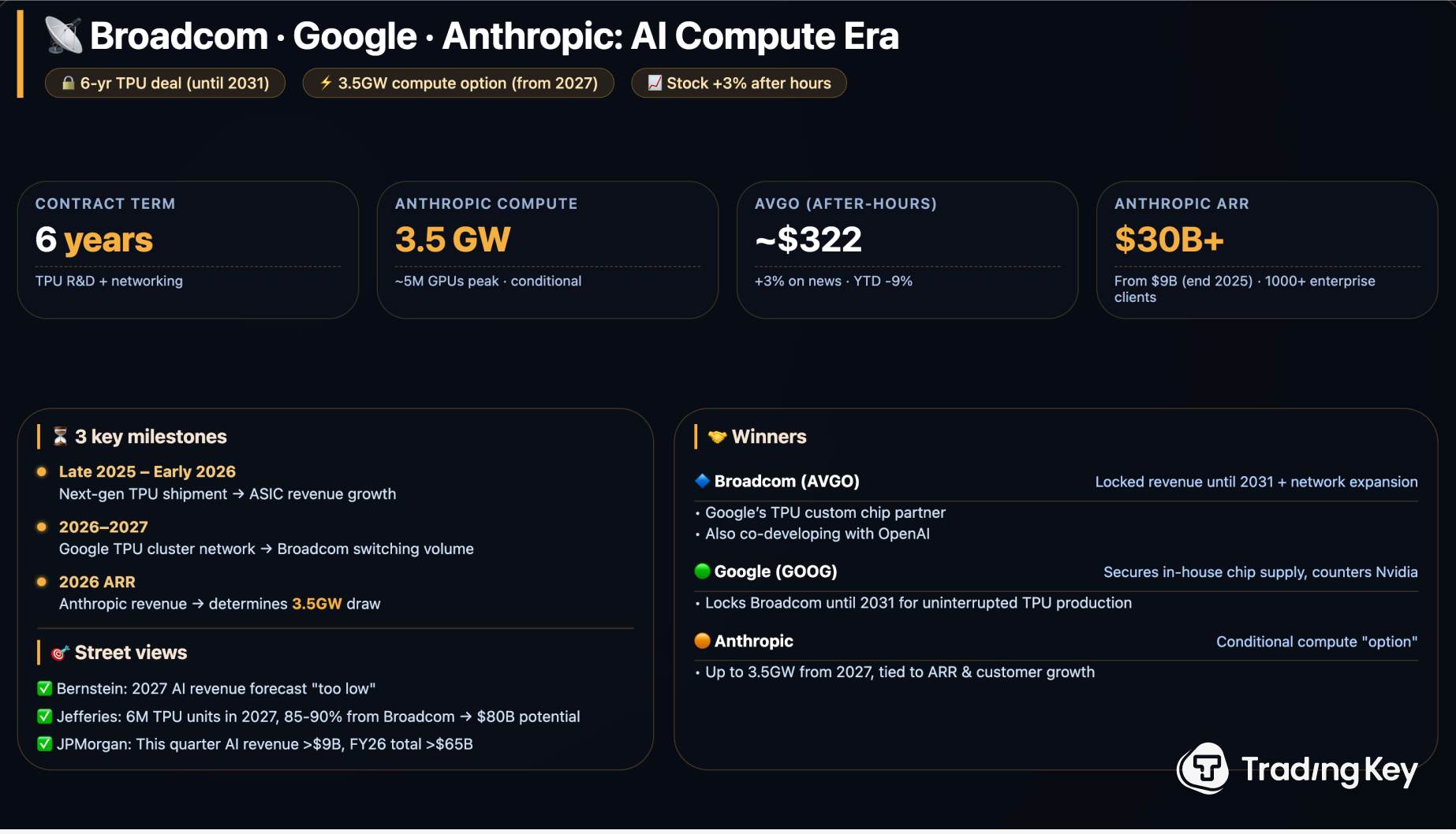

4. Anthropic扩大与谷歌及博通的算力合作,锁定数吉瓦级TPU产能

Anthropic宣布扩大与谷歌及博通的算力合作,提前锁定2027年起数吉瓦级的TPU庞大产能。同时,最新数据披露其年化营收已突破300亿美元。

300亿美元的年化营收固然亮眼,但真正刺痛神经的是“数吉瓦级”的电能承诺。前沿模型的竞争已经彻底演变成了一场拼产能、拼机架、拼变电站的重资产游戏。在这样的资本烈火烹油下,留给二线大模型厂商的突围窗口,可能只剩下一道门缝了。

5. Anthropic向网络安全合作伙伴预览Mythos模型

Anthropic向少数顶级安全企业和机构,定向开放了代号为Mythos的网络安全大模型预览版。该模型具备强大的智能体编程与系统交互能力,甚至能够自主识别复杂的零日漏洞。

把找漏洞的能力交给AI,就像是给网络世界的攻防战引入了核武器。Anthropic选择先给机构和顶级安全厂商“透底”,既是合规的求生欲,也是在确立自己的江湖地位。毕竟,能造出最锋利的矛的人,才有资格定义什么是最好的盾。

6. 谷歌低调上线离线优先AI语音转写应用Edge Eloquent

谷歌在iOS平台低调上线了基于Gemma端侧模型的离线优先语音转写应用Edge Eloquent。该产品主打高质量实时转录、极致的本地隐私保护,以及完全断网环境下的高可用性。

在所有巨头都在云端卷万亿参数的时候,谷歌悄悄把Gemma塞进了用户的口袋里。离线、隐私、断网可用,才是真正能渗透进医疗、法律和一线业务场景的杀手锏。有时候,边缘侧的“刚刚好”,比云端的“全知全能”更具商业杀伤力。

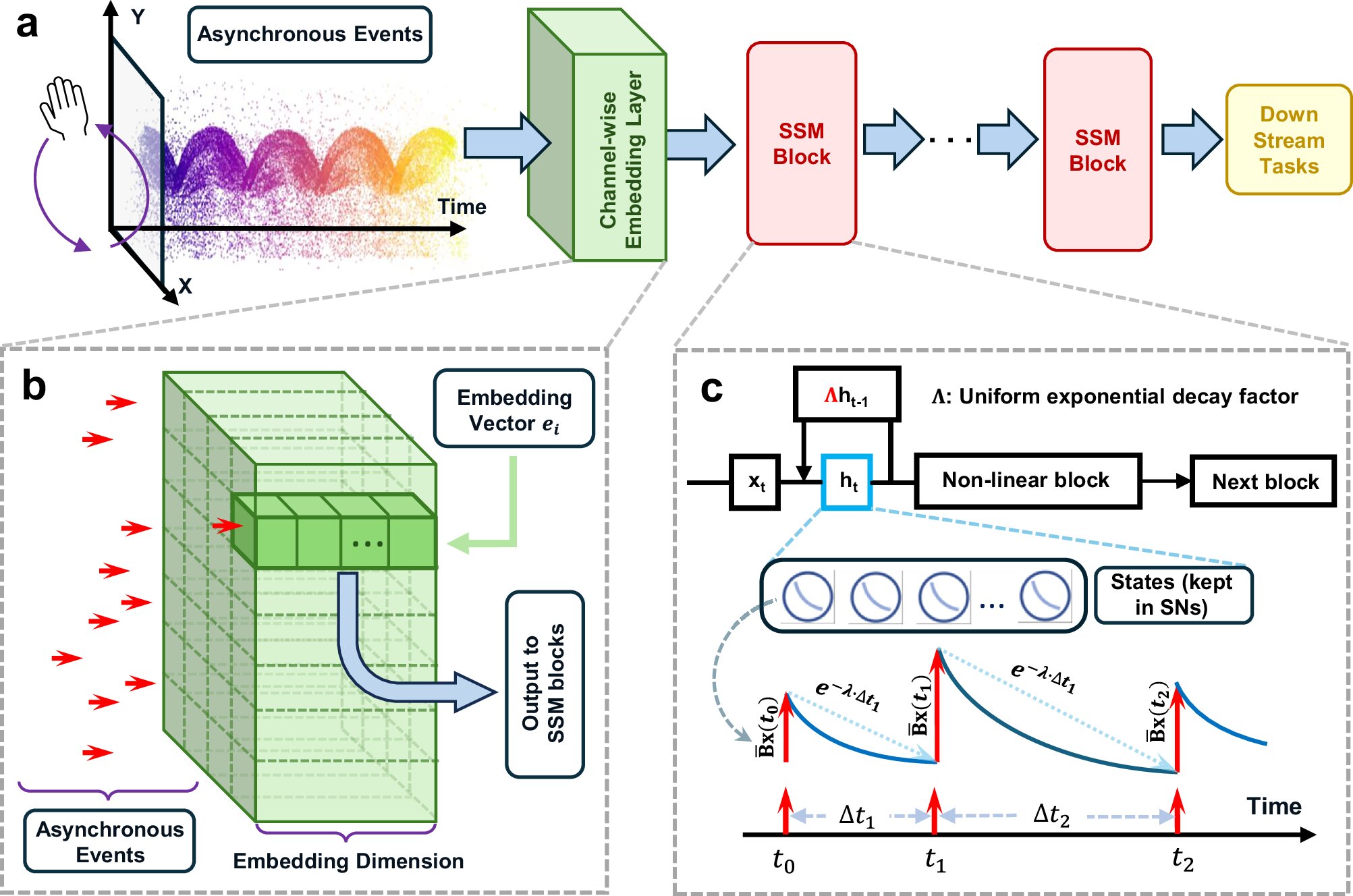

7. MIT推出CompreSSM:在训练过程中压缩状态空间模型

MIT等顶尖机构联合开发了CompreSSM技术,该技术创新性地在训练过程中而非事后压缩大型状态空间模型。它在保持预测准确率的同时,能显著提升模型训练速度并大幅缩减最终模型体积。

本周最硬核的工程福音。大模型一直被诟病为“能耗巨兽”,而这种在“胚胎期”就进行瘦身的技术,直接打在了降本增效的七寸上。对于苦算力久矣的学术界和中小企业来说,这比发个新跑分榜单实在得多。

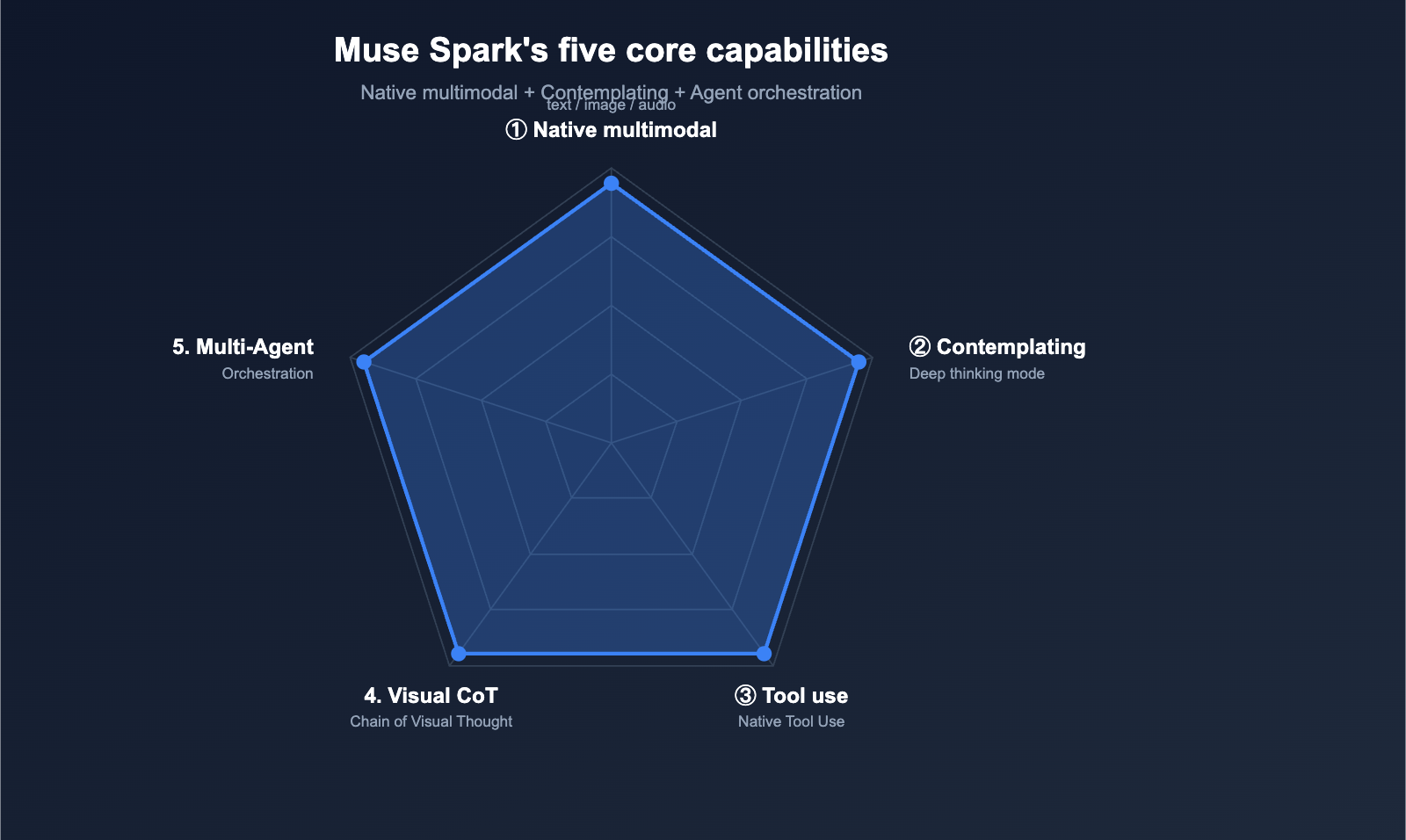

8. Meta发布多模态推理模型Muse Spark,主打"沉思"式内部协商机制

Meta正式发布原生多模态推理模型Muse Spark,主打创新的“沉思”模式。该模型通过内部子智能体群的激烈讨论再输出最终结果,这被Meta视为通向“个人超级智能”路线的核心基石。

Meta这次没有单纯秀参数,而是展示了AI的“组织架构”。让模型在回答前先“开个内部会”,这种设计契合了复杂商业决策的逻辑。AI助手正在从“秒回的客服”进化为“深思熟虑的参谋”,但就看Muse Spark后续能否真的证明自己。

9. CoreWeave与Meta签署210亿美元AI基础设施长约,覆盖至2032年

算力供应商CoreWeave与Meta签署了总额高达210亿美元、持续至2032年的AI基础设施超级长约。这笔天价订单将重点支持Meta未来大规模、高并发的生产级AI模型推理需求。

210亿美元,买的是长达6年的推理算力确定性。这标志着AI产业正式跨过了“烧钱炼丹”的草莽期,进入了“按表计费”的公用事业时代。Meta的这笔巨资押注,是对未来AI应用将如自来水般普及的最强背书。

10. 微软与阳狮集团扩大合作,共推全球智能体营销解决方案

微软与全球营销巨头阳狮集团宣布扩大战略合作,联合推出了一套结合Azure云底座、Copilot智能助手与Epsilon底层身份数据的全栈式、端到端智能体营销自动化解决方案。

广告狂人们终于迎来了赛博时代的收编。把营销策略、数据画像和投放执行全部交给智能体闭环,听起来是CMO的终极梦想。但这也抛出了一个灵魂拷问:当所有品牌都用着同样的微软智能体在同一个平台上竞价,最后的赢家,除了卖算力的微软,还会是谁?

11. 微软:从AI采用到前沿转型,企业规模化落地的关键要素

微软官方发文指出,当前企业AI的痛点已从初步尝试转向复杂的规模化落地。文章强调,管理层必须将AI视为具备高可靠性与严格可追责标准的核心业务系统,而不能仅仅当作简单的工具叠加。

大家都知道Pilot容易,Production难。文章的核心潜台词是:别再盲目买各种AI小工具了,赶紧把数据底座和混乱的权限治理收拾干净。没有干净的数据管道,再聪明的AI也只能产出高大上的垃圾。

12. Databricks:AI智能体的记忆扩展之道

Databricks创新性地提出“记忆扩展”概念,指出智能体的实际业务效果提升不能仅靠大模型推理,更深度依赖于对外部记忆(如历史对话、用户反馈)的高效治理、系统化管理和精准检索。

Databricks精准地切中了企业AI的痛点:没有业务记忆的AI,永远是个聪明的实习生。把“记忆”当成受治理的数据产品来建设,这是对“RAG(检索增强生成)”理念的工程化升华。企业护城河不在于你用了GPT-5还是Claude 4,而在于你喂给它们的那些别人拿不到的业务轨迹。

13. Zalando如何在Databricks上构建统一数据底座,支撑AI与分析

Databricks最新客户案例展示了欧洲电商Zalando如何通过构建统一的数据与语义层,彻底解决指标定义漂移,从而大幅提升自然语言商业分析和AI应用的底层可靠性。

如果在不同部门间连“净收入”的定义都无法达成共识,那么寄希望于AI来解决业务协同,无异于缘木求鱼。最前沿的AI应用,其成败往往取决于最基础的数据治理和语义统一。

14. Stability AI发布Brand Studio:品牌驱动的创意生产平台

Stability AI正式发布面向专业营销团队的Brand Studio创意平台。该平台支持深度定制品牌专属ID模型、引入审批驱动的业务工作流及精细化图像编辑,主打在规模化内容生产中保持品牌视觉一致性。

AIGC终于从“灵光一闪的盲盒”走向了“可控交付的工厂”。对于快消和广告行业来说,生成一百张好看的图不难,难的是这一百张图上的Logo位置和品牌调性丝毫不差。Brand Studio把审批流和精准控制融入平台,才是真正懂商业创意痛点的解法。

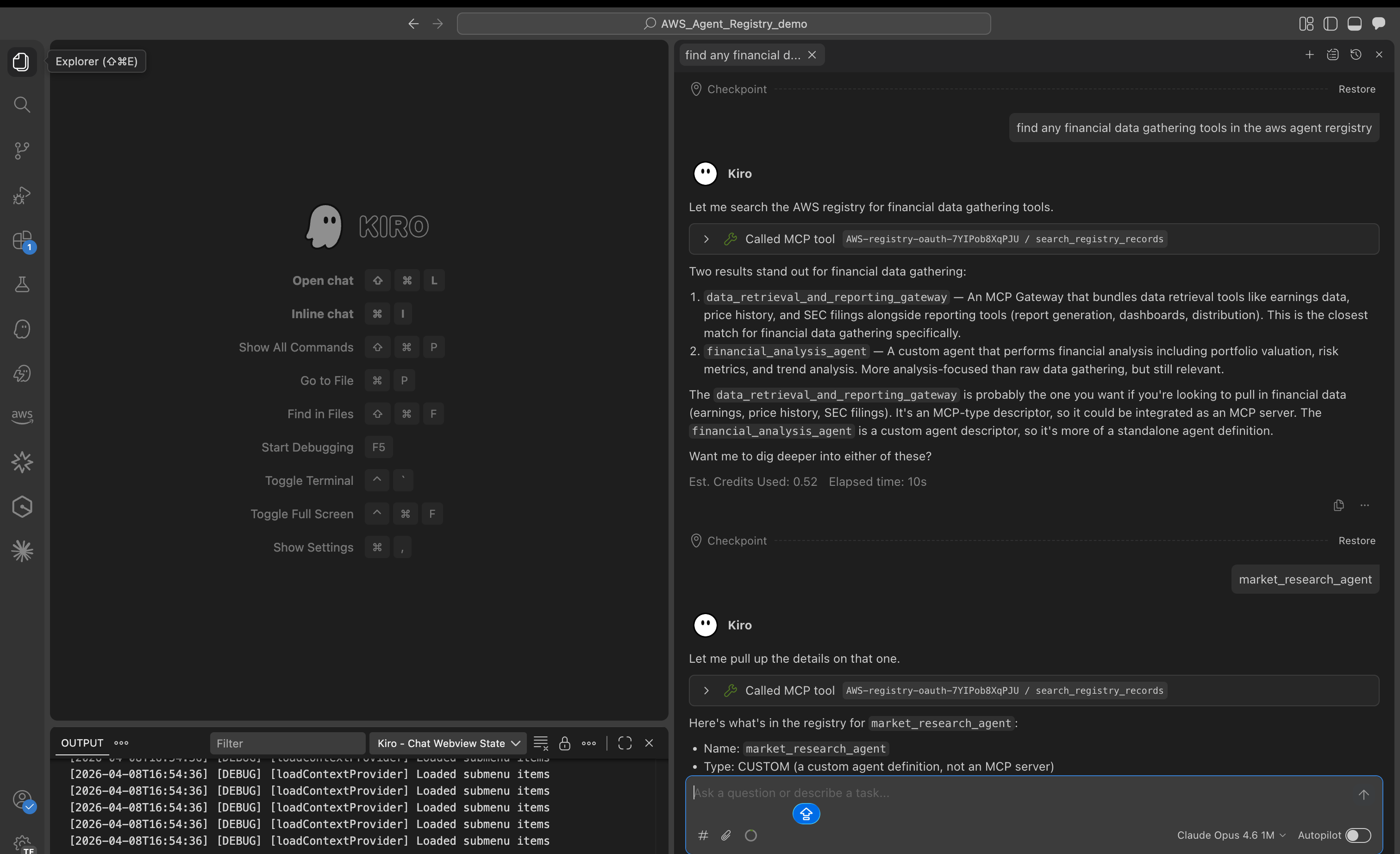

15. AWS推出Agent Registry预览版,构建企业级智能体管理中枢

AWS在AgentCore服务中重磅推出Agent Registry预览版。它作为企业内部集中发现、安全共享与高效复用AI智能体及底层工具的统一入口,旨在从根本上解决企业智能体泛滥与权限治理难题。

当每个部门都在造自己的小轮子时,AWS果断抛出了“车库”的钥匙。像管理API一样管理智能体,这标志着企业AI进入了工业化复用的新阶段。没有治理的规模化,只会带来一场昂贵的灾难。

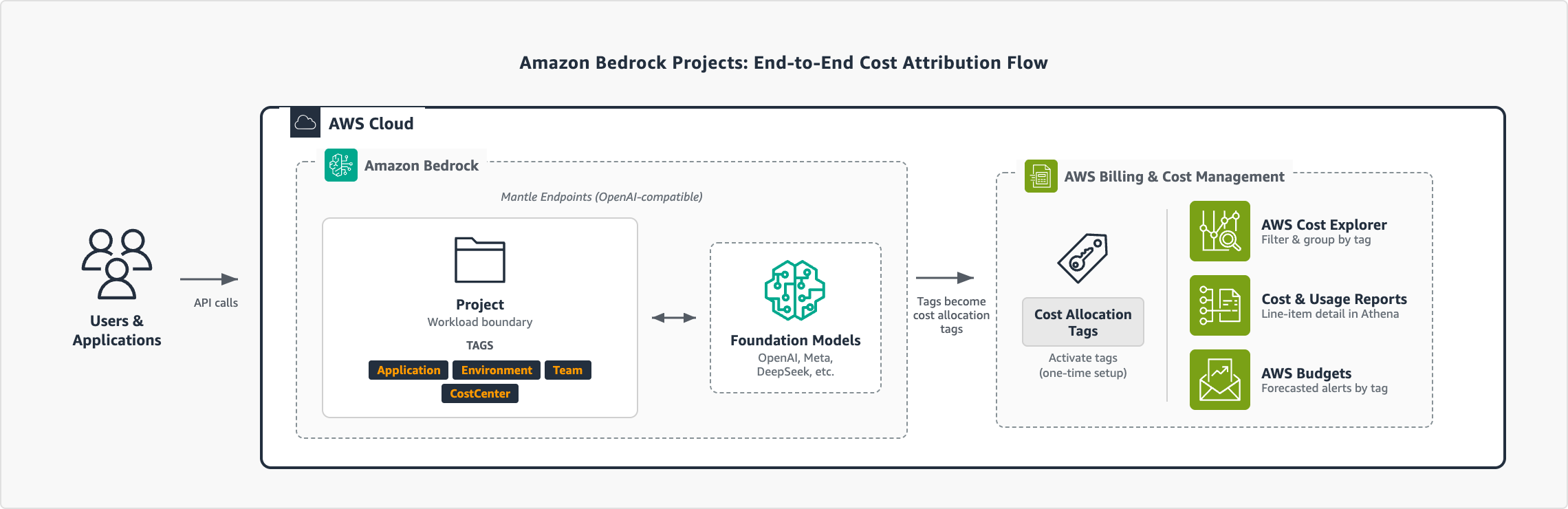

16. 用Amazon Bedrock Projects精细化管理AI推理成本

AWS详细介绍了Amazon Bedrock Projects功能。这是一种将生成式AI推理开销按具体工作负载进行组织和精细标记的机制,完美支持企业在多团队共享大模型时进行精准的成本分析与内部财务分摊。

大模型落地最尴尬的瞬间,莫过于年底CFO看着天价账单问“钱都花在哪了”。Bedrock Projects把云时代的FinOps逻辑平移到了AI推理上,这不仅是财务工具,更是倒逼业务部门在ROI面前保持清醒的戒尺。

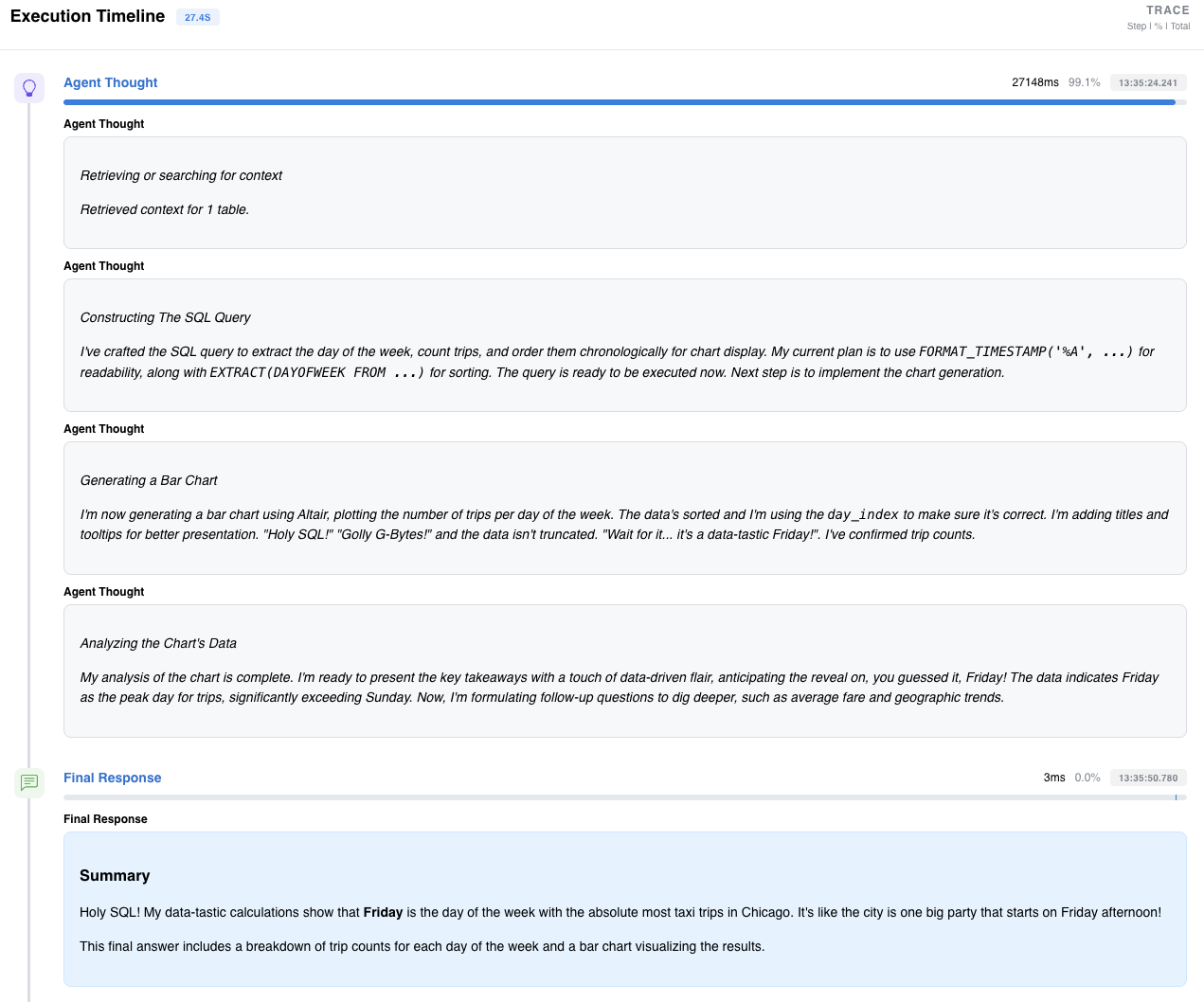

17. Google Cloud:如何用Prism对对话式分析智能体进行评测

Google Cloud详细介绍了如何利用Prism框架对对话式数据分析智能体进行严谨评测。强调必须在多轮复杂对话、自然语言模糊性及底层数据准确性上,建立高度可重复的自动化评测标准流程。

不要让AI带着致命的自信胡说八道。把评测(Eval)变成一种产品化的流水线,这是把AI从玩具变成生产力工具的必经之路。如果连测试集都无法代表真实的业务挑战,那么部署上线的就不是助手,而是一颗定时炸弹。

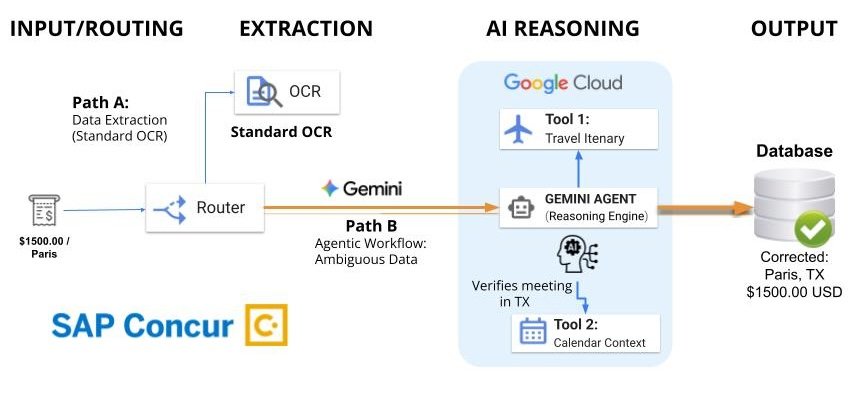

18. SAP Concur:智能体AI如何自动化处理费用报销

企业软件巨头SAP Concur展示了如何利用智能体化AI彻底自动化处理繁琐的费用报销流程。系统通过无缝串联复杂文档理解、外部工具调用和智能异常追问,在多区域、多政策环境下大幅提升了财务效率与合规性。

大概是打工人和财务最喜闻乐见的AI应用了。报销这种高度繁琐、规则繁多的流程,天生就是智能体的绝佳试验场。但魔鬼在细节里:当AI开始帮你算账,如何确保它的“聪明”没有触碰合规的红线?

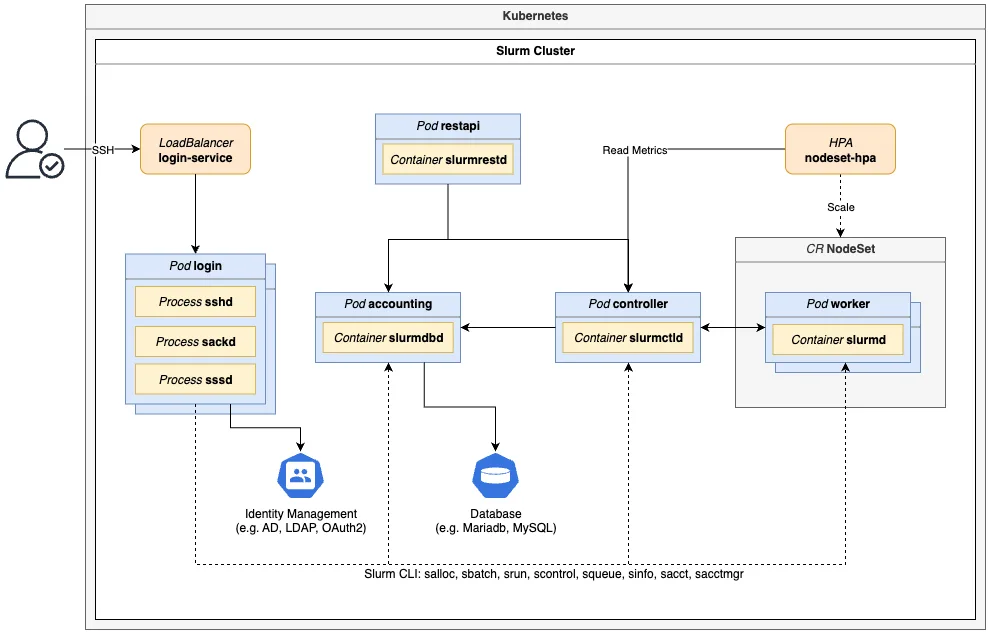

19. NVIDIA:在Kubernetes中结合Slurm运行大规模GPU工作负载

NVIDIA官方发布了在Kubernetes环境中深度结合Slurm运行大规模GPU工作负载的权威指南。旨在完美融合云原生运维的极简自动化与传统HPC调度对多节点GPU作业的超高资源利用率优势。

基础设施层面的“联姻”。Kubernetes的弹性和Slurm的高效并行,解决的正是大模型时代最让人头疼的“算力孤岛”问题。当AI从实验室玩具变成工厂车间的重型设备,运维的专业度和资源调度能力,将直接决定企业的算力成本底线。

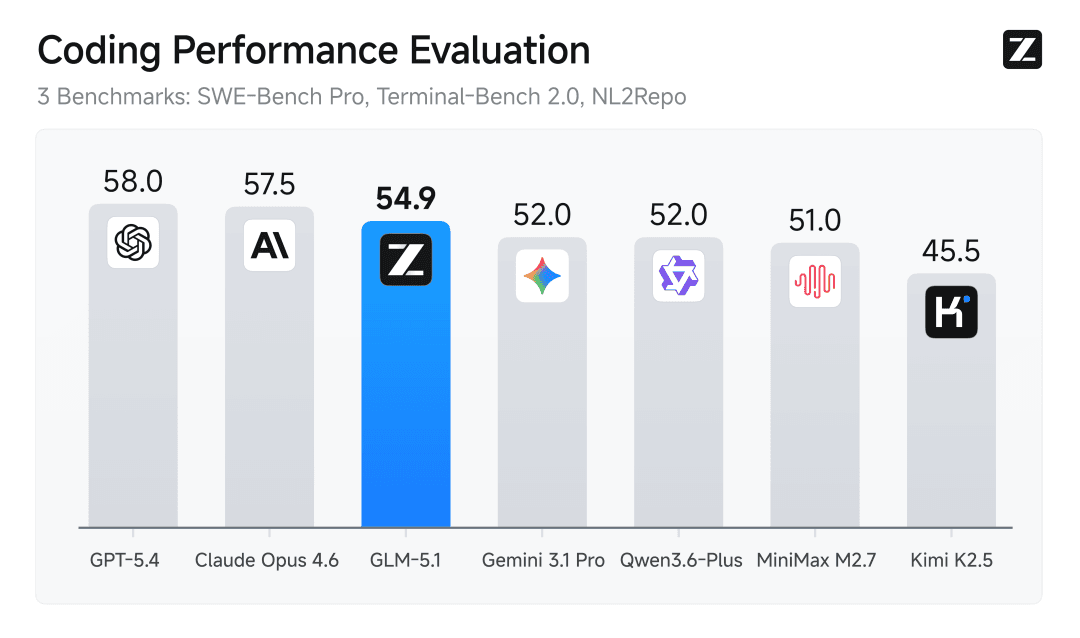

20. 智谱发布旗舰开源模型GLM-5.1,专攻长程自主任务执行

国内大模型头部企业智谱正式发布GLM-5.1旗舰开源模型。该模型专为复杂的长程自主任务执行与软件工程智能进行了深度优化,惊人地支持超8小时的超长任务闭环,并在多项国际权威编码基准上表现优异。

长任务闭环能力,才是真正拉开“闲聊机器人”和“生产力助手”差距的试金石。智谱这次的发布,是国产大模型在工程化上的重要一步,也意味着“按小时计费”的AI员工已经开始敲响人类程序员的饭碗。

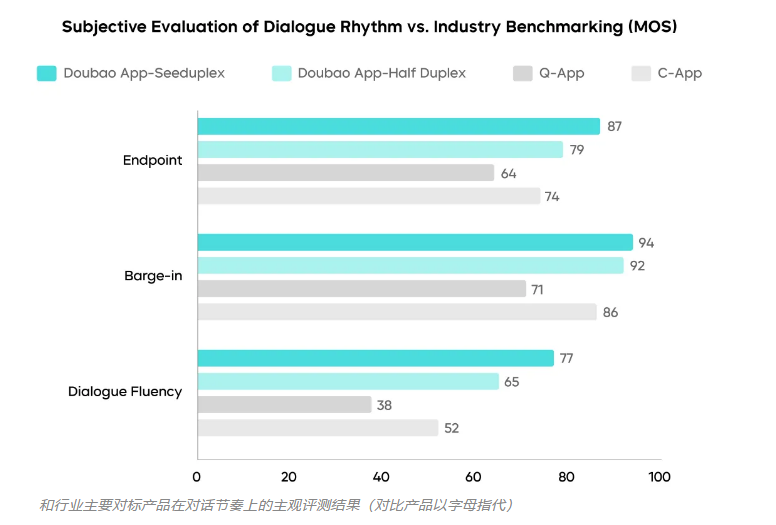

21. Seed 全双工语音大模型发布:懂倾听、抗干扰,走向更自然的交互

字节跳动旗下Seed团队重磅发布原生全双工语音大模型Seeduplex。该模型不仅完美支持极具人情味的“边听边说”及自然对话打断,更在底层架构上大幅增强了复杂环境下的抗噪声干扰能力。

语音交互的终极目标不是字正腔圆,而是能在嘈杂的街头听懂你的随口一说。全双工模式打破了过去那种“对讲机式”的尴尬,让AI助手终于有了一点“人味儿”。对于客服、外卖小哥和一线销售来说,这可能比任何花哨的文本大模型都更实用。

22. Qwen Code周报:跨平台操作、定时任务与规划模式全面上线

阿里Qwen Code发布最新周报,核心更新引入了跨平台远程操作、标准的Cron计划任务调度以及深度的/plan规划模式等重磅功能,进一步推动代码智能体从测试沙盒无缝嵌入企业真实的自动化工作流。

把AI从对话框里解放出来,接上微信、钉钉和定时任务,这才是真正懂业务痛点的产品经理。Qwen Code正在把“程序员”这个职业变成“监工”,这不仅是效率的提升,更是工作模式的重构。只要权限护栏建得够高,这种自动化带来的红利将是惊人的。

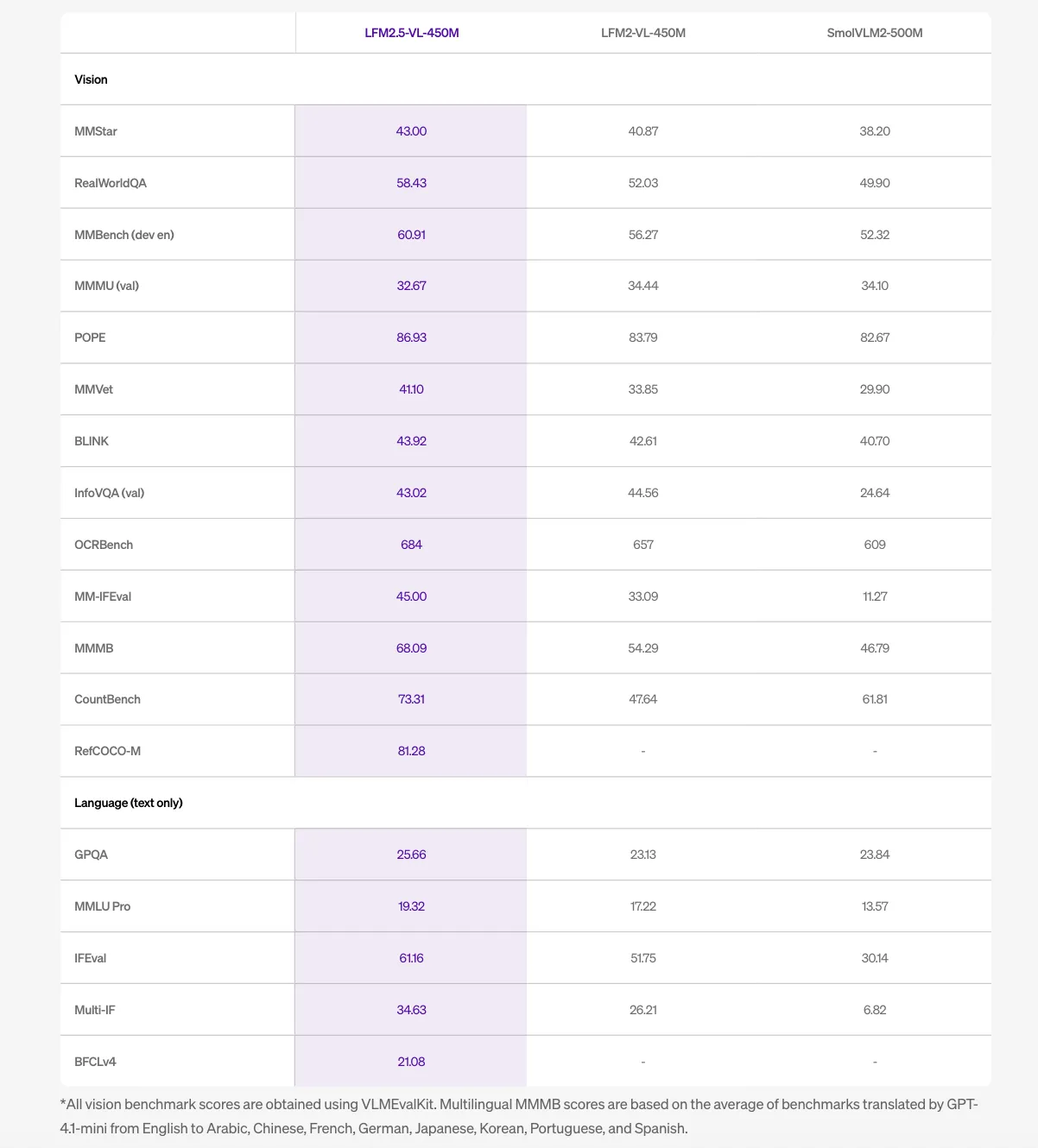

23. Liquid AI发布边缘多模态模型LFM2.5-VL-450M,支持目标框预测与50+语言

明星初创Liquid AI发布了仅4.5亿参数的极小边缘多模态模型LFM2.5-VL-450M。新版本不仅新增了精准的图像目标框预测、深度指令遵循优化及超50种语言支持,更能在普通笔记本和手机上实现极速运行。

不要迷信云端的庞然大物,边缘侧的“小快灵”往往能解决更多接地气的问题。在成本敏感、隐私要求高或网络受限的场景下,一个能在手机上跑得飞起的多模态小模型,其商业价值绝对不亚于那些需要整个数据中心来支撑的千亿巨兽。

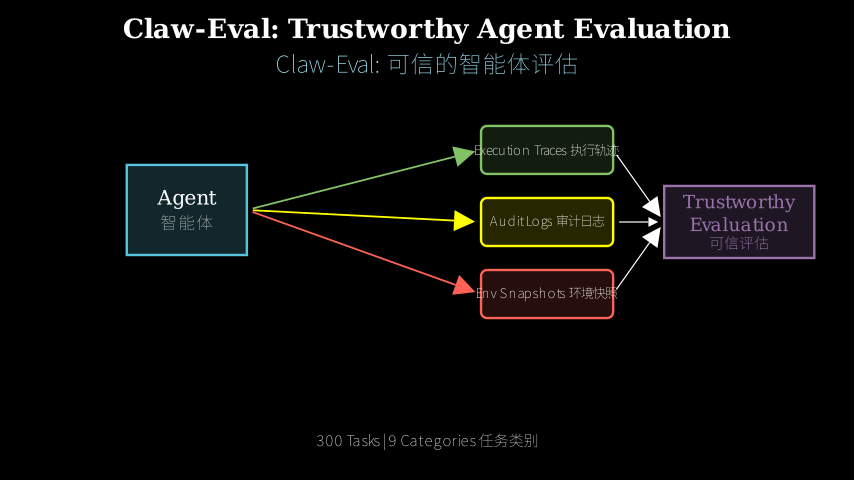

24. Claw-Eval:迈向可信赖的自主智能体评测体系

学术界发布Claw-Eval重磅论文,提出一套面向真实复杂软件环境的端到端智能体评测体系。研究尖锐指出,传统只看最终结果的评测会漏掉大量过程中的安全违规与鲁棒性失败,强调评测必须完整覆盖AI的多步执行轨迹。

这是一篇戳破了当前智能体评测泡沫的论文。只看结果不看过程,就像只看财报不看合规一样危险。当智能体开始代替人类执行复杂任务时,我们不仅要知道它“能不能做完”,更要知道它“有没有在中间闯祸”。没有过程审计的AI,永远无法真正进入核心业务。

结语 (The Takeaway)

本周的AI世界,呈现出一种极其务实的“工业化”倾向。从算力的长期合约锁定,到智能体的目录管理、成本分摊与过程评测,所有的新闻都在指向同一个事实:AI已经度过了概念炒作期,正在进入拼执行、拼治理、拼ROI的成熟期。

最危险的事,是继续用买SaaS软件的思维去买AI。当AI成为像水和电一样的基础设施时,企业的护城河将不再是拥有哪个模型,而是如何将这些模型安全、高效、可追责地编织进自己的业务流水线中。在这个过程中,数据底座的统一、语义的规范以及评测体系的建立,远比追逐最新的模型跑分来得重要。